可生成图片类型(推荐)

可生成数据表类型(推荐)

| |

| 节点状态 | 在V1.0部署

|

|---|---|

Logistic分类器  | |

| 节点开发者 | 决策链算法研发部 (Dev.Team-DPS) |

| 节点英文名 | Logistic Classification Learner |

| 功能主类别 | 机器学习 |

| 英文缩写 | LogisticGBM |

| 功能亚类别 | 分类训练器 |

| 节点类型 | 数据挖掘 |

| 开发语言 | Python |

| 节点简介 | |

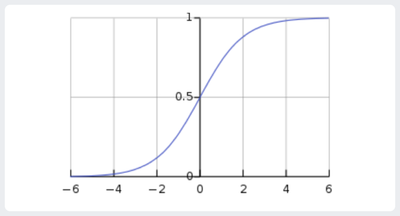

在机器学习中,逻辑回归分类器(Logistic Regression Classifier)是一种常用的分类算法,用于解决二分类问题。虽然名字中包含"回归"一词,但实际上逻辑回归是一种分类算法,而不是回归算法。逻辑回归分类器的基本原理是通过将线性回归模型的输出映射到一个概率值,并使用一个阈值来进行分类决策。 该模型假设输出变量(也称为标签或类别)服从二项分布,即属于两个可能的类别之一。逻辑回归分类器使用的函数称为逻辑函数(或称为sigmoid函数),它能够将任意实数映射到0到1之间的概率值。 | |

| 端口数量与逻辑控制(PC) | |

| Input-入口 | 2个 |

| Output-出口 | 3个 |

| Loop-支持循环 | 否 |

| If/Switch-支持逻辑判断 | 否 |

| 输入输出 | |

| 相关节点 | |

| 上一节点 | CatBoost |

| 下一节点 | LightGBM |

在统计学中,逻辑模型(或logit模型)是一种统计模型,将事件的对数概率建模为一个或多个自变量的线性组合。在回归分析中,逻辑回归[1](或logit回归)是估计逻辑模型的参数(线性组合中的系数)。形式上,在二元逻辑回归中,有一个由指标变量编码的单一二元因变量,其中两个值被标记为“0”和“1”,而自变量可以分别是二元变量(两类,由指标变量进行编码)或连续变量(任何实值)[2]。对数赔率量表的计量单位被称为logit,来自逻辑单位。

该节点使用Python编写,调用scikit-learn包[3]。以下为示例代码:

from sklearn.datasets import load_iris

from sklearn.linear_model import LogisticRegression

X, y = load_iris(return_X_y=True)

clf = LogisticRegression(random_state=0).fit(X, y)

clf.predict(X[:2, :])

clf.predict_proba(X[:2, :])

clf.score(X, y)

拟合后,模型可以用于预测样本的类别,可以在通用预测模块实现内外部测试集的预测。

{{cite journal}}: CS1 maint: multiple names: authors list (link)

查找其他类别的节点,请参考以下列表